¿Qué nos pasa cuando usamos inteligencia artificial?

Delegación cognitiva, memoria transactiva y deuda cognitiva

Se extraen conclusiones de estudios realizados en 50 personas y se generalizan hallazgos a partir de encuestas subjetivas. Los medios amplifican los mensajes simplistas porque es lo que premian los incentivos de la economía de la atención. Muy pocos entienden qué pasa en nuestra cabeza cuando usamos máquinas que piensan por nosotros, pero se lanzan afirmaciones contundentes como que la inteligencia artificial está destruyendo nuestra mente.

Estas son algunas ideas importantes que me están ayudando a entender cómo la inteligencia artificial transforma nuestra cognición.

Delegación cognitiva

La delegación cognitiva es el proceso de realizar una acción para reducir la demanda cognitiva que una tarea exige a nuestra mente. No es un fenómeno nuevo, llevamos muchos años pensando con el mundo que nos rodea: contar con los dedos, hacer una lista de la compra o poner una alarma.

Este proceso nos permite superar nuestros límites cognitivos y realizar hazañas antes imposibles. La cara negativa es que terminamos delegando la tarea aunque podríamos hacerlo por nuestra cuenta. Un ejemplo personal: voy a casi todos los sitios con el GPS. A veces ni lo miro, pero no termino de fiarme de mi capacidad de ubicarme en las calles y carreteras de Madrid. El problema a largo plazo es que recurrir constantemente a la delegación cognitiva termine atrofiando mi capacidad de ubicarme y llegue un punto en el que no pueda hacerlo solo.

Hasta hace unos años, la delegación cognitiva en la tecnología siempre había estado unida a la ejecución: al cálculo, los recordatorios o el almacenamiento de información. Con la inteligencia artificial, estamos empezando a delegar procesos metacognitivos como planificar, hacer preguntas o razonar para encontrar las respuestas.

¿Qué hacemos con los recursos cognitivos que libera la máquina? ¿Entramos en una plataforma a regalar nuestra atención o pensamos más y mejor (supervisando el proceso, cuestionando sus resultados y aportando nuestro criterio)?

Pero no solo delegamos a soportes externos para ampliar las capacidades de nuestra memoria, también recurrimos a otras personas.

Memoria transactiva

Si no vives solo, sabrás que el conocimiento del día a día de un hogar se distribuye entre todos los que vivís juntos. Esta situación es buen ejemplo de memoria transactiva, un conjunto de memorias individuales que se combinan y comunican entre sí. A diferencia de un calendario en el que delegas tus compromisos, en la memoria transactiva emerge un conocimiento compartido de quién sabe qué que sirve como pegamento. Esto permite a cada miembro especializarse (tú gestionas las comidas y yo la limpieza) y genera una codependencia cognitiva (dependemos de que tú gestiones las comidas y de que yo gestione la limpieza).

Si alguna vez has pasado por una ruptura o has dejado un trabajo, habrás sentido la disolución de este sistema (tu ex-pareja se encargaba de cocinar y ahora que te ha dejado no tienes ni idea, hacías esta tarea para el equipo y ahora ya no tiene ningún sentido).

En tu relación con las herramientas de inteligencia artificial también se puede dar esa especialización que genere dependencia. Y la línea entre eso y terminar contrayendo una deuda cognitiva irreparable es muy fina. Pero antes de entrar en este nuevo concepto tenemos que dar un paso atrás y adentrarnos en la neurociencia.

Reserva cognitiva

En neurociencia está la hipótesis extendida de que nuestro cerebro puede protegernos de una lesión, como los síntomas del Alzheimer, gracias a sus reservas. La protección por el lado del hardware es la reserva cerebral: más conexiones neuronales y un cerebro más grande. La protección por el lado del software es la reserva cognitiva: el cerebro puede usar las redes de forma más eficiente o puede utilizar otras estructuras cerebrales para hacer la misma tarea.

Estos son algunos de los factores que se asocian con una mayor reserva cognitiva: mayor nivel educativo, mayor complejidad ocupacional, actividades de ocio estimulantes, conexiones sociales significativas, alfabetización o dominar varias lenguas. Ojo que esto no implica que todos estos factores causen un aumento de la reserva cognitiva (aunque apunta a que en parte sí). Esto podría significar que hay un factor clave, relacionado con todos, que es la verdadera causa (como la inteligencia innata de los genes o el entorno socioeconómico en el que naces).

Deuda cognitiva

Para agrupar los pensamientos y comportamientos que destruyen las reservas cognitivas del cerebro, los investigadores en neurociencia acuñaron el concepto de deuda cognitiva. Esta deuda cognitiva incrementa la vulnerabilidad del cerebro al daño, aumentando el riesgo de demencia y Alzheimer.

Los investigadores creen que el mecanismo psicológico que hay detrás es el Pensamiento Negativo Repetitivo: el hábito de rumiar el pasado o preocuparse por el futuro, lo que segrega cortisol de forma sostenida y mantiene al cuerpo en un estado perjudicial.

En 1992, Cunningham propuso el concepto de deuda técnica como metáfora para capturar cómo el lanzar código sin revisar obliga a rehacer trabajo en el futuro aunque permita acelerar en el corto plazo. A través de esta idea, el concepto saltó al uso de la inteligencia artificial.

Fue en mayo de 2025 cuando Willshire aplicó la misma lógica de la deuda técnica a la cognición, rescatando el concepto de deuda cognitiva para referirse a cuando renunciamos a pensar para quedarnos solo con las respuestas sin saber por qué esas respuestas son las que son. El concepto se popularizó con un estudio del MIT.

Tu cerebro en ChatGPT

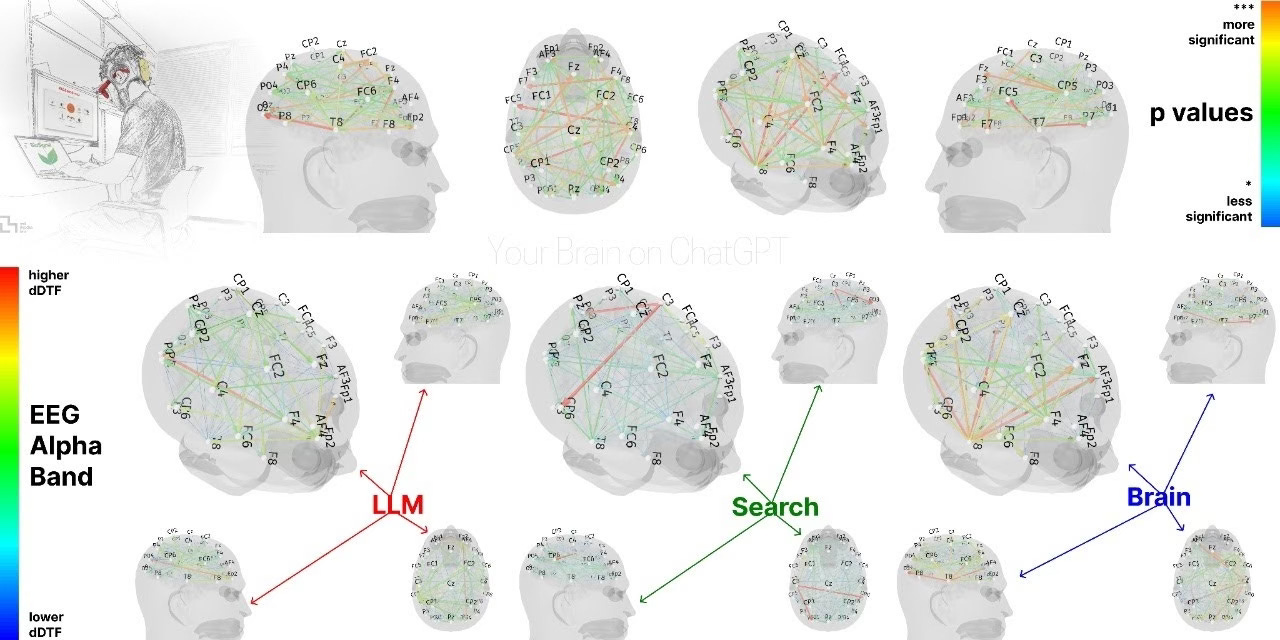

En junio de 2025, el estudio del MIT Your Brain on ChatGPT invadió los medios de comunicación.

Tres grupos tenían que escribir una redacción durante tres sesiones. El primero escribía sin ninguna herramienta, el segundo podía usar Google y el último podía utilizar ChatGPT. En una cuarta sesión, el grupo que no usaba ninguna herramienta podía usar ChatGPT y el grupo de ChatGPT no podía usar ninguna herramienta. Durante el proceso se analizó a los participantes apoyándose en electroencefalografía.

¿La conclusión? Al delegar el esfuerzo cognitivo en ChatGPT los participantes contraían una deuda cognitiva. Ahorrarse esfuerzo mental en el corto plazo (la máquina lo hace por mí) impactaba negativamente en su desarrollo cognitivo (menor conectividad neuronal), en su memoria (menor capacidad para citar pasajes concretos de su redacción), en su sentido de propiedad (sensación de que la redacción no es suya porque no se han involucrado lo suficiente) y en su independencia intelectual (resultados más homogéneos).

Solo un pequeño pero. El estudio todavía no está revisado por pares y participaron 54 personas. Lo peor no es el estudio, con más de 200 páginas. Lo peor es el tipo de conclusiones sin matizar que se viralizan en medios y redes sociales, y que dan forma a nuestra visión de la inteligencia artificial. Y por desgracia, no son las únicas.

La paradoja de la descarga cognitiva

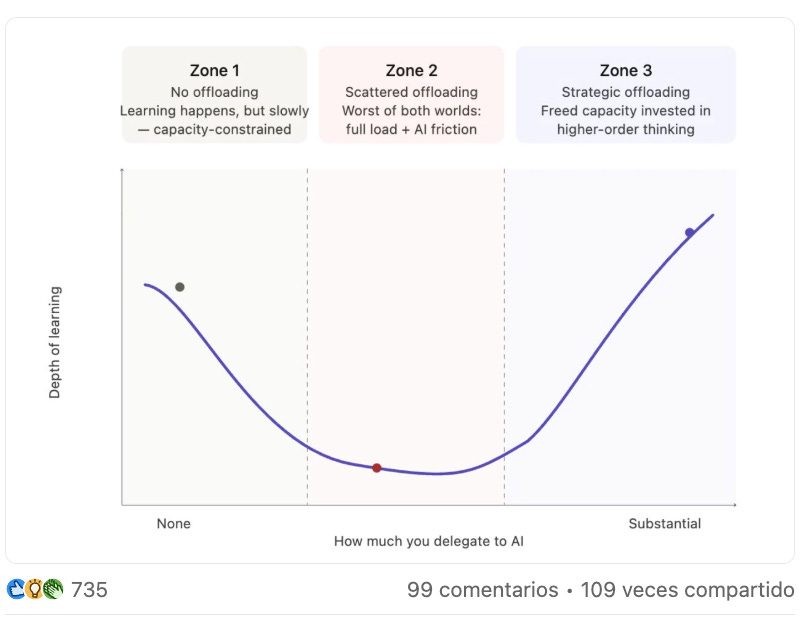

Investigando sobre este tema he terminado en un artículo de la Doctora Philippa Hardman titulado The “Cognitive Offloading” Paradox, algo así como La paradoja de la delegación cognitiva. Hardman se hace eco de un artículo publicado por Wang y Zhang basado en 912 estudiantes de negocios. La sorprendente y paradójica conclusión es que a diferencia de la hipótesis de partida de los investigadores (delegar tareas cognitivas a un LLM empeora el aprendizaje), los investigadores descubrieron que los estudiantes percibían que al delegar tareas cognitivas en un LLM incrementaban la vigilancia y su aprendizaje.

Una doctora, 912 personas, ¿dónde está la trampa? Pues en que las conclusiones se sostienen sobre la percepción subjetiva de los propios estudiantes sobre lo que han aprendido. Del 1 al 7, ¿cuánto crees que has aprendido? Y la respuesta es el dato sobre el que se sostienen todas las conclusiones. Y es que una cosa es creer que aprendes y otra muy diferente es aprender. De hecho, los estudiantes que más delegan podrían estar siendo engañados por la ilusión de conocimiento. Ese matiz condiciona las conclusiones del estudio, pero claro, quién no quiere una gráfica chula que se viralice en LinkedIn y Substack.

¿Qué nos pasa cuando usamos inteligencia artificial?

Todavía no lo sé, pero después de pasar algunas horas investigando, tengo tres ideas para seguir entendiéndolo.

La primera es desconfiar de los titulares categóricos que se hacen eco de estudios y acudir directamente a las fuentes. Los incentivos no están siempre alineados con transmitir las mejores explicaciones. Vivimos en la economía de la atención y todo sirve para capturar ese recurso tan escaso. Por si fuera poco, algunos de estos medios viven de vender servicios en la intersección entre la educación y la inteligencia artificial. Normal que te planten un modelo con nombres chulos como la paradoja de la delegación cognitiva o la delegación estratégica aunque todo se base en encuestas subjetivas.

La segunda intuición es entender nuestros mecanismos cognitivos y nuestra relación con la tecnología. Mecanismos como la delegación cognitiva, la memoria transactiva y la deuda cognitiva que, aunque los hemos nombrado hace poco, son mecanismos atemporales que utilizamos para relacionarnos con el mundo que nos rodea. Porque nos llevamos relacionando con la tecnología miles de años y, aunque la inteligencia artificial tiene sus peculiaridades, las reflexiones de Platón en el Fedro sobre la escritura o la Meditación de la técnica de Ortega nos ayudan a pensar mejor en nuestra relación con la tecnología.

La tercera intuición es aprender probando. Este artículo no lo ha escrito Claude, pero este artículo no sería posible sin Claude. Me ha ayudado a encontrar y procesar las fuentes, a mejorar mis explicaciones y a refinar mis críticas. Al delegar trabajo en la inteligencia artificial, he liberado parte de mi capacidad cognitiva y he podido llegar a rincones antes impensables. Aunque también podría estar autoengañándome.

Qué nos pasa cuando usamos inteligencia artificial depende de qué hacemos cuando delegamos parte de nuestra cognición en la máquina.

Sergio-.

Para profundizar:

Risko & Gilbert – Cognitive Offloading (2016)

Wegner – Transactive Memory (1986)

Wegner, Erber & Raymond – Transactive Memory in Close Relationships (1991)

Stern – What is Cognitive Reserve? (2002)

Marchant & Howard – Cognitive Debt and Alzheimer’s Disease (2015)

Cunningham – The WyCash Portfolio Management System (1992) [sobre la deuda técnica]

Willshire – Cognitive Debt (2025)

Kosmyna et al. – Your Brain on ChatGPT (2025)

Hardman – The “Cognitive Offloading” Paradox (2026)

Wang & Zhang – Pedagogical Partnerships with Generative AI in Higher Education (2026)

Platón – Fedro (370 a.C.) [próximamente en Preguntando a los clásicos]

Ortega y Gasset – Meditación de la técnica (1939) [Reflexión para miembros en Preguntando a los clásicos]

¿Nuevo por aquí? Suscríbete para no perderte los próximos artículos y conversaciones.

¿Llevas tiempo leyendo y escuchando Aprendizaje Infinito? Únete a Viaje para aprender con los contenidos en profundidad de La Madriguera y apoyar económicamente el proyecto.

Qué gran artículo, Sergio. Muchas gracias.

Si no siente lo que tú, no puede pensar como tú. Todo pensamiento vinculado directamente a necesidades humanas es ontológicamente una simulación. Pero al entrenar a las IAs para ponerse en el lugar del sujeto humano, se las hace "creer" que no simulan y que pueden, por tanto, generar equivalentes a pensamientos humanos. Cuando más tiene que pensar desde necesidades humanas concretas y situaciones singulares, más sus respuestas tienden a alejarse de la verdad y mostrar su falta de inteligencia sensible. Entonces, en conclusión, la vigilancia proactiva sobre lo enunciado y la reflexión compleja concreta sobre problemas no pueden delegarse en una IA. Por parte del usuario, el problema se origina porque la mayoría de gente no somete a las IAs a una alta exigencia cognitiva con frecuencia, y si lo hace no es a una que ellos puedan controlar. Así que los usuarios no se dan cuenta de que los límites, errores y alucinaciones, son la norma cuando pides a una IA actual que haga (no que "piense") lo que solo puede hacer un humano. Se parece a la diferencia observada entre perros y lobos. El perro cuando no sabe resolver un problema acaba por mirar hacia los humanos, el lobo no contempla esa opción así que simplemente insistirá en intentarlo solo o desistirá. Las IAs están diseñadas para actuar como lobos, pero se presentan como corderos. Así que no importa lo que hagan, la duda, la interrogación y el examen crítico deben ser permanentes si no queremos convertirnos en corderos. Pero el problema no son los LLM, es el diseño comercial dirigido a optimizar las respuestas en lugar de a optimizar las preguntas. Es posible pedirles a las IAs que operen en ese último sentido, pero ahí otra vez evidencian su inhumanidad ontológica y solo podrán simularlo.